de l’empathie pour des robots?

La majorité d’entre nous éprouvons facilement de l’empathie pour les êtres humains. (Enfin, je l’espère!) Mais qu’en est-il de notre empathie envers… les robots?

Espace publicitaire

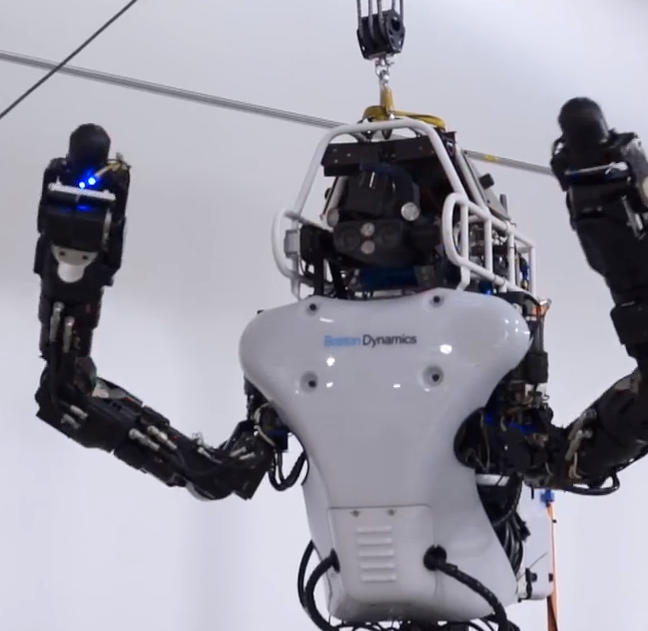

Des scientifiques ont voulu savoir…

Espace publicitaire

Espace publicitaire

Oui, l’intelligence artificielle nous surprendrait déjà positivement et pourrait davantage le faire d’ici les prochaines années. Le problème cependant ne serait jamais elles mais bel et bien nous et en fonction de l’orientation prise par nos algorithmes, à savoir ce que nous pourrions entre autres privilégier dans nos sociétés dites modernes. Est-ce que en plus ou moins (le quantitatif) plutôt qu’en tout ou rien (le qualitatif) pourraient être priviégiés comme problématiques le sexisme, l’homophobie… le commerce, l’industrie et Dieu on ne saurait quoi d’autre du genre exclusivement ou si tous ces paramètres en même temps (l’écosystème)? Est-ce qu’il pourrait y en avoir d’autres aussi? Est-ce que de l’infiniment petit à l’infiniment grand autrement dit tout pourra être considéré une fois pour toutes les fois ou si nous devrons toujours nous ajuster au fur et à mesure dans le but de définir (le qualitatif) l’univers dans lequel nous nous croirions tous inclus? Ne s’agirait-il pas toujours ici et encore une fois de la fameuse question ontologique à savoir ce que serait l’être comme toute chose par extension ?